AI Act 2024/1689: Ghid practic de etică și transparență pentru dezvoltatorii români de sisteme AI

Introducere: Ce înseamnă AI Act pentru România?

Regulamentul (UE) 2024/1689 — cunoscut ca EU AI Act — este primul cadru legal obligatoriu din lume dedicat integral inteligenței artificiale. Intrat în vigoare la 1 august 2024 și aplicabil progresiv până în 2027, acesta impune obligații concrete furnizorilor, operatorilor și importatorilor de sisteme AI din toate statele membre, inclusiv din România.

Pentru companiile și dezvoltatorii români care construiesc sau integrează soluții bazate pe AI — de la chatboți și sisteme de recrutare, la instrumente medicale sau de scoring financiar — conformitatea nu mai este opțională. Sancțiunile pot ajunge la 35 milioane euro sau 7% pentru încălcările privind practicile AI interzise conform Art. 5 sau, pentru alte neconformități, amenda este de 15 milioane euro sau 3% din cifra de afaceri.

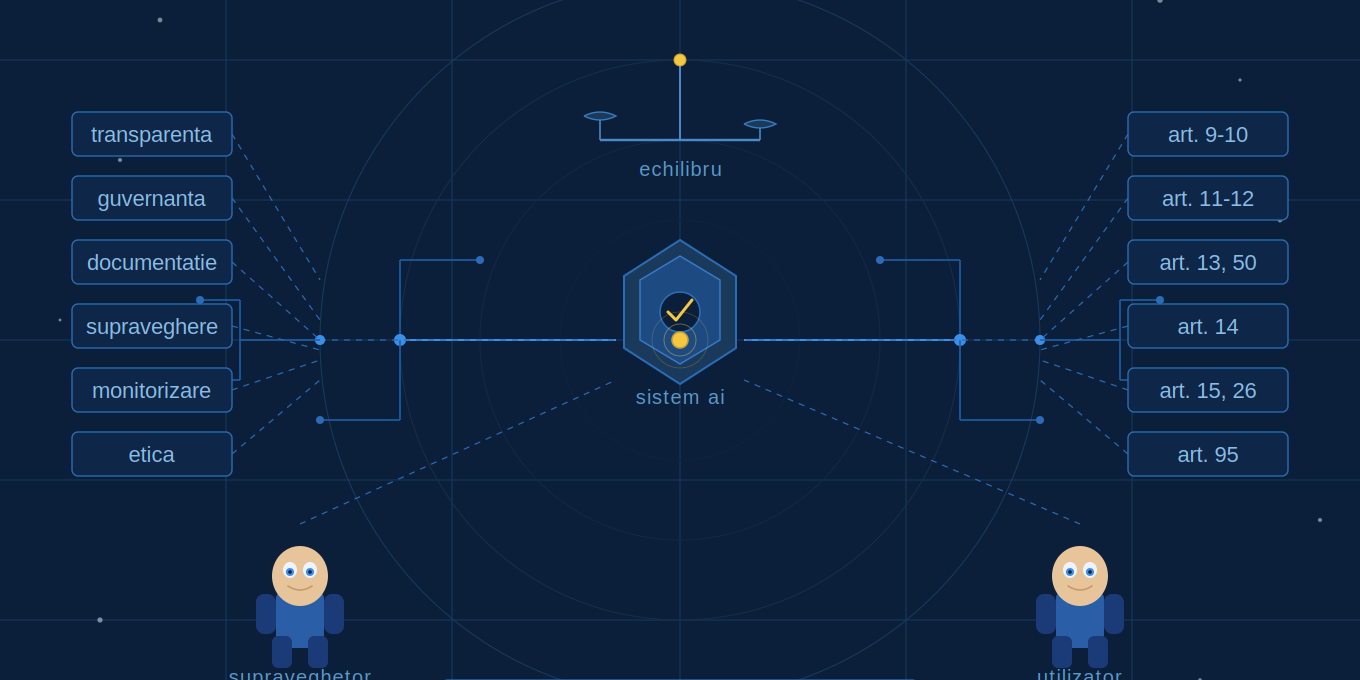

Acest articol prezintă, structurat pe articole de regulament, măsurile concrete de etică și transparență pe care fiecare echipă de dezvoltare trebuie să le implementeze.

| 7 domenii de acțiune | 35M € amendă maximă | 6 luni păstrare log-uri | 2027 aplicare deplină |

| Art. 12 + Art. 19 + Art 26 | 1. Guvernanța și managementul datelor |

Calitatea datelor este fundația oricărui sistem AI responsabil. Regulamentul impune instituirea unor politici clare de guvernanță a datelor care să garanteze corectitudinea, relevanța și actualitatea seturilor de antrenament și operare.

Principalele obligații operaționale includ:

- Implementarea principiilor privacy by design și security by design din faza de proiectare a sistemului, nu ca un add-on ulterior

- Asigurarea trasabilității complete a datelor și a tuturor operațiunilor efectuate de sistemul AI

- Păstrarea jurnalelor (log-urilor) cel puțin 6 luni pentru scopuri de audit și investigații ulterioare

| Sfat practic Integrați auditarea datelor în pipeline-ul CI/CD și documentați proveniența fiecărui set de date folosit la antrenare. Folosiți soluții de data lineage precum Apache Atlas sau MLflow pentru automatizarea trasabilității. |

| Art. 11–12 | 2. Documentația tehnică completă și accesibilă |

Orice sistem AI cu risc ridicat trebuie să fie însoțit de o documentație tehnică detaliată și actualizată permanent, care să acopere arhitectura, scopurile, algoritmii, modelele de antrenament, evaluările efectuate și măsurile de control implementate.

Documentația trebuie să fie disponibilă imediat pentru autoritățile de reglementare și, la cerere, accesibilă părților interesate. Lipsa documentației complete este una dintre cele mai frecvente cauze de neconformitate identificate în audituri europene.

- Crearea și menținerea actualizată a documentației tehnice pentru fiecare versiune a sistemului

- Descrierea clară a arhitecturii, scopurilor, limitărilor și datelor de antrenament

- Documentarea evaluărilor de risc și a măsurilor de mitigare implementate

| Art. 13, 50 | 3. Transparență față de utilizatori și persoane afectate |

Utilizatorii trebuie informați clar și accesibil că interacționează cu un sistem AI, cu indicarea scopului, capacităților și limitărilor acestuia. Aceasta nu este o recomandare — este o obligație legală.

| Informare clară Utilizatorul știe că vorbește cu AI și înțelege limitele sistemului și scopul utilizării | Explicații semnificative Persoanele afectate de decizii AI au dreptul să înțeleagă cum s-a ajuns la acea decizie | Marcarea conținutului Text, audio, video sau imagini generate sintetic trebuie marcate clar pentru a preveni manipularea |

În cazul sistemelor AI cu risc ridicat care influențează decizii cu impact semnificativ (angajare, credit, sănătate), persoanele afectate au dreptul de a primi explicații semnificative despre rolul AI și elementele determinante ale deciziilor.

| Art. 14 | 4. Supravegherea umană efectivă |

Regulamentul nu acceptă supravegherea formală sau simbolică. Este obligatorie implementarea unui mecanism real de human-in-the-loop, cu desemnarea unor persoane competente care pot interveni și corecta deciziile automate eronate sau nedrepte.

| Atenție — cerință critică Un buton de override ascuns în interfață sau o procedură neaplicată în practică nu constituie supraveghere umană conformă cu regulamentul. Supravegherea trebuie să fie reală, documentată și auditabilă. |

- Desemnarea unor persoane competente care supervizează funcționarea sistemului AI

- Implementarea unor proceduri clare de intervenție și corectare a deciziilor automate

- Documentarea tuturor intervențiilor umane pentru audit ulterior

| Art. 15, 26 | 5. Monitorizare continuă și răspuns post-punere pe piață |

Conformitatea nu se obține o singură dată și nu se menține de la sine. Regulamentul impune monitorizarea continuă a performanței și a riscurilor după lansarea pe piață, inclusiv un sistem intern de notificare rapidă a incidentelor.

- Monitorizarea continuă a performanței și a riscurilor sistemului AI după punerea în funcțiune

- Implementarea unui sistem intern de notificare rapidă a incidentelor grave către autoritățile competente

- Cooperarea deplină cu autoritățile de supraveghere (în România: ANPDCP și autoritățile sectoriale desemnate) și cu autoritățile europene

AI Act 2024/1689: Ghid practic de etică și transparență pentru dezvoltatorii români de sisteme AI

| Art. 95 | 6. Coduri de conduită voluntare și indicatori de performanță |

Participarea activă la elaborarea sau aderarea la coduri de conduită sectoriale și trans-sectoriale nu este obligatorie, dar reprezintă un avantaj competitiv semnificativ. Demonstrarea unor indicatori cheie de performanță (KPI) de conformitate etică crește credibilitatea față de parteneri și clienți europeni.

- Participarea la elaborarea sau aderarea la coduri de conduită sectoriale și trans-sectoriale

- Adoptarea unor KPI de conformitate etică și publicarea rapoartelor de transparență AI

- Promovarea sustenabilității și incluziunii în procesele de dezvoltare AI

| Art. 4 | 7. Educație și alfabetizare în domeniul AI |

Toți membrii echipelor implicate în dezvoltarea, implementarea și utilizarea sistemelor AI trebuie să dețină competențe actualizate privind riscurile, oportunitățile și obligațiile legale. Formarea continuă nu este un beneficiu opțional — este o cerință explicită a regulamentului.

- Programe de formare continuă pentru toți membrii echipei implicate în ciclul de viață AI

- Certificări și cursuri specifice privind etica AI, protecția datelor și conformitatea cu AI Act

- Actualizarea periodică a cunoștințelor pe măsura evoluției regulamentului și a ghidurilor de implementare

| Concluzie: Conformitatea ca avantaj competitiv Prin aplicarea acestor măsuri, dezvoltatorii români nu doar respectă cadrul legal european obligatoriu — ci și câștigă încrederea utilizatorilor, reduc riscurile reputaționale și juridice și facilitează accesul pe piața UE pentru sistemele lor AI, într-un mod responsabil și durabil. În contextul în care partenerii europeni evaluează din ce în ce mai atent conformitatea furnizorilor, a fi AI Act-ready devine un diferențiator real de piață. |

AI Act 2024/1689: Ghid practic de etică și transparență pentru dezvoltatorii români de sisteme AI – Afla mai multe aici